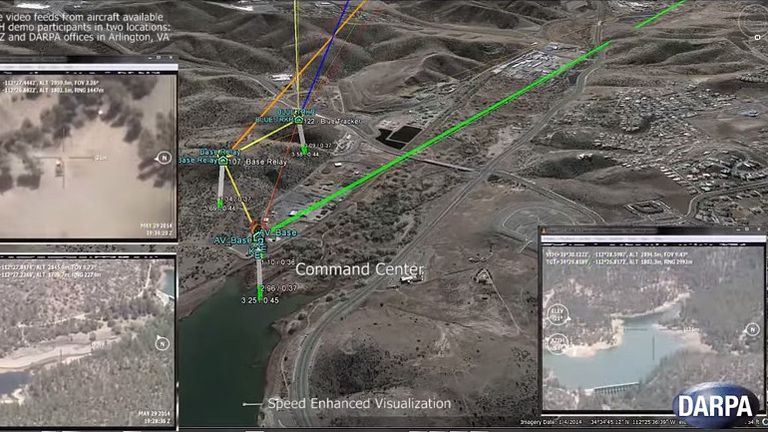

Velike vojne sile poput SAD-a, Velike Britanije, Izraela i drugih već neko vrijeme rade na tzv. robotima ubojicama, odnosno robotima koji bi na bojnom polju mogli sami donositi odluke i boriti se s neprijateljima. S obzirom da takvim robotima ne bi upravljali ljudi, već bi s njima upravljao softver, odnosno umjetna inteligencija, mnogi stručnjaci upozoravaju na potencijalne crne scenarije koji bi se mogli dogoditi ako se takvi roboti otmu kontroli i, umjesto neprijateljskih vojnika, pobiju vlastite vojnike ili civile. Iako takvi roboti još nemaju dozvolu za sudjelovanje u ratovima, sigurno je da će ratovima i vojnim sukobima u budućnosti velikim dijelom upravljati softver i umjetna inteligencija, prenijeli su mišljenja vojnih stručnjaka na New York Timesu.

tri vijesti o kojima se priča

Osim robota ubojica, proizvođači oružja razvijaju i pametne bombe kojima također neće upravljati ljudi, već će umjetna inteligencija navoditi rakete i bombe i odlučivat će o metama napada, a kako oružje postaje 'pametnije', sve je više upozorenja kako će ljudi sve teže kontrolirati takvo naoružanje. Zagovornici pametnog oružja i robota kojima upravlja umjetna inteligencija smatraju da će se na ovaj način smanjiti žrtve ratovanja jer bi precizne pametne bombe mogle razlikovati vojne od civilnih ciljeva tako da bi civili bili puno sigurniji. Velika Britanija, Izrael i Norveška već razvijaju takve rakete i bespilotne letjelice s kojima ne bi upravljali ljudi, već će se oslanjati na brojne senzore i umjetnu inteligenciju koja će odlučivati o tome kada i koje ciljeve napasti.

Britanski Brimstone projektili tako mogu razlikovati tenkove od automobila i autobusa i mogu pratiti ciljeve u zadanim područjima bez ikakvog (ljudskog) navođenja sa zemlje, a više projektila čak može i međusobno komunicirati oko meta napada. Takvo je oružje odavno u planovima vojska najvećih svjetskih zemalja, samo se podaci o njemu drže tajnima, upozorio je stručnjak za umjetnu inteligenciju iz Self-Aware Sysemsa Steve Omohundro. Glavno pitanje koje se treba postaviti vezano za razvoj ovakvog naoružanja jest kako se definiraju mete napada i tko odabire te mete – ljudi ili softver, komentirao je za NY Times Peter Asaro iz međunarodnog odbora za kontrolu robotskog naoružanja.

Lockheed Martin trenutno razvija dalekometni projektil za uništavanje brodova koji će, bez ikakvog navođenja sa zemlje, potpuno autonomno letjeti stotinama kilometara i manevrirati kako bi izbjegao radare, a iako u Pentagonu tvrde da će ljudi donositi odluke o metama napada takvih projektila, iz Lokheeda to nisu potvrdili jer je riječ o povjerljivim informacijama. Ako će takvi i slični projektili autonomno letjeti zrakom, bez da su navođeni sa zemlje i ako će, umjesto ljudi, softver donositi odluke o napadu na određene ciljeve, uvijek postoji bojazan da bi se stvari mogle oteti kontroli te da bi, umjesto vojnih ciljeva, takvi projektili mogli napasti civilne ciljeve, gradove i slično.

Također, kod takvih situacija postavlja se i pitanje odgovornosti jer, ako je softver 'kriv' za napad na civilne ciljeve i ljudske žrtve, tko će snositi odgovornost i tko će biti kažnjen za takve napade.

Foto: DARPA/YouTube