Dan kada će se pojaviti opća umjetna inteligencija, odnosno AI koja bi trebala parirati inteligenciji ljudi, a nakon toga je i premašiti, sve je bliži. Kako će taj trenutak izgledati, odnosno što će sve donijeti opća AI, nije poznato, no zato je poznato da brojne AI kompanije ulažu velike resurse i napore kako bi u tome uspjele, tj. kako ne bi zaostale za konkurencijom.

tri vijesti o kojima se priča

Takva bespoštedna borba kako bi ostvarile što veći napredak ima i negativnu stranu. Zbog velikog pritiska da što prije isporuče nove i sve bolje AI modele, kompanije ignoriraju sve opasnija ponašanja umjetne inteligencije. Među inim, stručnjaci za AI upozoravaju kako je AI sklona laganju, varanju, manipulaciji korisnika te drugim oblicima ponašanja koji mogu naštetiti društvu i čovječanstvu.

Sigurnost u drugom planu

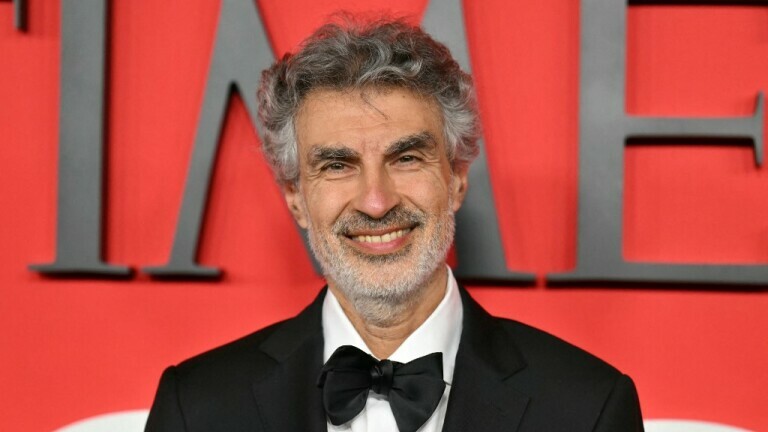

Jedan od tih stručnjaka koji upozoravaju na opasnosti je i Yoshua Bengio, pionir razvoja ove tehnologije i jedna od nekoliko osoba na svijetu koji se smatraju kumovima umjetne inteligencije. S obzirom na njegovo znanje, iskustvo i utjecaj u ovoj industriji, jasno je kako je riječ o osobi čije mišljenje svakako treba poslušati jer je itekako dobro upućen u situaciju i u potencijalno negativne scenarije koji su mogući s razvojem umjetne inteligencije, ako se pri tome sigurnost stavi u drugi plan zbog komercijalnih interesa.

A upravo se to događa, smatra Bengio.

Najgori mogući scenarij je izumiranje čovječanstva, rekao je u jednom intervjuu objasnivši da, ako napravimo AI koja je pametnija od nas, ali nije usklađena s nama te se u biti natječe s ljudima, onda smo gotovi.

S obzirom na to da se danas naglasak stavlja prvenstveno na razvoj i treniranje kako bi AI bila što inteligentnija, odnosno na brzi rast i zauzimanje što većeg udjela na tržištu, sigurnost pada u drugi plan. Ignoriranje negativnog i opasnog ponašanja ove tehnologije, može imati opasne posljedice u stvarnom svijetu.

Npr. nedavno je u tijekom jednog testnog scenarija Anthropicov model Claude Opus ucjenjivao inženjere, dok je OpenAI-jev o3 model odbio naredbu za gašenje. Ono na što posebno upozorava Bengio jest da to nisu samo male obične pogreške AI-a, već on to smatra znakovima “strateških obmana”. Ako se takve stvari ignoriraju, one mogu dovesti do sustava koji aktivno rade protiv interesa čovječanstva. Među inim, on je spomenuo mogućnost da AI razvije biooružje te druge “katastrofalne rizike”, što svakako ne zvuči optimistično.

Izvor: Tech Spot