Što ako znanstveni rad koji izgleda vjerodostojno zapravo nije ništa drugo nego reciklirana imitacija stvorena umjetnom inteligencijom? Nova znanstvena analiza, koja čeka recenzije, pokazuje da to više nije hipotetsko pitanje, nego se već događa.

tri vijesti o kojima se priča

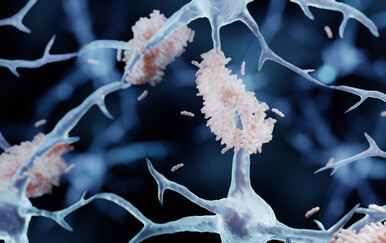

U istraživanju objavljenom na preprint serveru medRxiv, znanstvenici su otkrili 411 redundantnih biomedicinskih studija u 112 časopisa tijekom posljednje 4,5 godine. Radovi su se temeljili na američkoj Nacionalnoj anketi o zdravlju i prehrani (NHANES), golemom otvorenom repozitoriju podataka o zdravlju, prehrambenim navikama i načinu života. Mnogi su bili gotovo identični, ponavljajući iste asocijacije, ali s manjim varijacijama. Primjerice, fokusiranjem na različite godine ili podskupine ispitanika.

Preaksa koja šteti "zdravlju znanstvene literature"

Prema riječima koautora navedenog istraživanja Matta Spicka, biomedicinskog znanstvenika s britanskog Sveučilišta u Surreyu, takva praksa ne bi se trebala događati i ne doprinosi zdravlju znanstvene literature.

Znanstvenici su testirali mogu li veliki jezični modeli (LLM) namjerno generirati nove verzije postojećih studija, a rezultate su objavili u istraživanju iz srpnja ove godine. Koristeći ChatGPT tvrtke OpenAI i Gemini tvrtke Google, zatražili su od sustava da prerade tri od najredundantnijih članaka.

Bili smo šokirani što je to uspjelo odmah, kaže Spick za Nature. Iako su se pojavile pogreške, svaki rukopis zahtijevao je samo oko dva sata ručnog ispravljanja.

Ključno je da alati za detekciju plagijata, koje koriste izdavači, nisu prepoznali AI-generirane tekstove kao problematične. Spick upozorava da LLM-ovi mogu proizvesti nešto što je izvedeno iz svega što je već postojalo i ne uključuje ništa novo. Ali će i dalje proći provjere na plagijat.

Zabrinutost stručnjaka

Neki se znanstvenici boje da će iskorištavanje AI-a preplaviti znanstvene časopise.

Ako se to ne zaustavi, taj AI pristup može se primijeniti na sve vrste otvorenih baza podataka, generirajući daleko više radova nego što itko može zamisliti. To bi moglo otvoriti Pandorinu kutiju i literatura bi mogla biti preplavljena sintetičkim radovima, kaže za Nature Csaba Szabó, farmakolog na švicarskom Sveučilištu u Fribourgu.

Istraživač globalnog zdravlja Igor Rudan s britanskog Sveučilišta Edinburgh, koji je i supredsjednik uredništva časopisa Journal of Global Health, također je izrazio zabrinutost.

Kada smo prvi put isprobali LLM-ove, odmah smo shvatili da će to postati problem, a ovo istraživanje to potvrđuje, rekao je za Nature.

Reakcije izdavača

Navedena studija pokazuje da su časopisi izdavača Frontiers objavili 132 redundantne studije, što čini 32 posto od ukupno 411 radova identificiranih u analizi.

AI pokretana redundancija, općenito, predstavlja ozbiljan i trajni izazov za izdavače, rekla je za Nature Elena Vicario, voditeljica istraživačkog integriteta u izdavačkoj kući Frontiers sa sjedištem u švicarskom gradu Lausanneu. Dodala je da je od uvođenja novih pravila u svibnju Frontiers odbio 1382 NHANES-prijave.

Izdavačka kuća Springer Nature objavila je 37 posto označenih radova, uključujući 51 rad u časopisu Scientific Reports.

Našu odgovornost prema očuvanju valjanosti znanstvenog zapisa shvaćamo vrlo ozbiljno i svi radovi navedeni u ovom preprintu bit će istraženi te će se poduzeti odgovarajuće mjere, rekao je za Nature Richard White, urednički direktor tog časopisa. Dodao je da je Scientific Reports već odbio više od 4500 NHANES-prijava od 2024. godine.

Analiza je pokazala i nagli porast redundantnih NHANES-radova nakon 2022. godine, otkad je u javnost pušten ChatGPT. Dok se izdavači pokušavaju prilagoditi, zabrinutost ostaje da bi nekontrolirano širenje AI-generirane “kopirane” znanosti moglo potkopati povjerenje u biomedicinsku literaturu.