Prema profesorici sa Sveučilišta u Oxfordu, vjerojatnost "apokaliptičnog scenarija" izazvanog umjetnom inteligencijom (AI) je 'blizu nule'.

tri vijesti o kojima se priča

Kao odgovor na pismo koje je objavio Centar za sigurnost umjetne inteligencije u San Franciscu, u kojem se upozorava na potencijalne opasnosti umjetne inteligencije, profesorica Sandra Wachter je to odbacila kao 'reklamni trik'. Povećani rizik usporedila je sa znanstvenom fantastikom sličnom popularnom holivudskom filmu Terminator.

Postoje rizici, postoje ozbiljni rizici, ali nisu rizici ono što trenutno privlači svu pozornost... Cijeli se diskurs stavlja na nešto što se može ili ne mora dogoditi za nekoliko stotinu godina. Ali pristranost i diskriminaciju mogu izmjeriti, mogu izmjeriti utjecaj na okoliš... To je predstava za javnost. Privući će sredstva. Usredotočimo se na zamjenu radnih mjesta ljudi. Te su stvari potpuno zanemarene zbog Terminator scenarija, kaže Watcher.

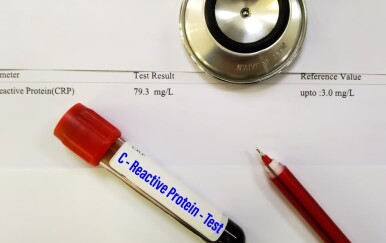

Iako priznaje pozitivne aspekte umjetne inteligencije, kao što je njezina sposobnost da pomogne u zadacima koji spašavaju živote, poput medicinske analize, profesorica Wachter tvrdi da bi trenutni diskurs trebao dati prioritet pitanjima kao što su premještanje s posla, uzrokovano umjetnom inteligencijom kao i šire etičke implikacije njezine upotrebe.

Pismo, koje je sstavio spomenuti Centar za sigurnost umjetne inteligencije, poziva na globalno određivanje prioriteta za ublažavanje rizika povezanih s umjetnom inteligencijom. Potpisale su ga istaknute osobe u zajednici umjetne inteligencije, uključujući pojedince iz Google DeepMinda i Anthropica, kao i Geoffreya Hintona, poznatog pionira umjetne inteligencije. Hinton je nedavno izrazio zabrinutost o potencijalnoj štetnosti umjetne inteligencije u pogrešnim rukama, što je dovelo do njegove ostavke u Googleu.

Zaključno, dok postoje različita mišljenja u vezi s rizicima i implikacijama umjetne inteligencije, profesorica Wachter naglasila je potrebu za pristupom tom problemu koji se bavi sadašnjim izazovima i razmatra šire društvene utjecaje tehnologije umjetne inteligencije.

Izvor: Daily Mail