Jedna od vrućih tema u tehnologiji jest umjetna inteligencija i njezina primjena, odnosno treba li je ograničiti kako se ne bi iskorištavala u negativne svrhe. O tome raspravljaju i zakonodavna tijela u SAD-u i na razini Europske unije, ali neki konkretan zakon ili pravila još nisu doneseni jer je riječ o kompleksnom problemu.

tri vijesti o kojima se priča

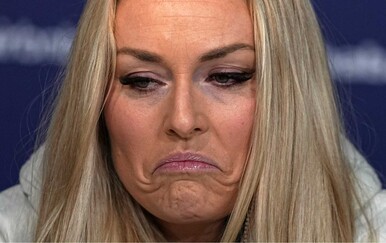

Naime, regulativnom se ne želi sputati i ograničiti razvoj umjetne inteligencije, no nužno je spriječiti da npr. tehnologiju prepoznavanja lica koja je bazirana na AI svatko primjenjuje kako želi jer se time narušava privatnost. Također, velik su problem i tzv. deepfake videozapisi u kojima se na postojeće videozapise postavljaju lica drugih osoba. Problem je što takvi videozapisi izgledaju tako realno da je teško razlikovati lažna videa od stvarnih.

Koliko je to opasno i kakvi su sve negativni načini primjene deepfakea, najbolje pokazuju primjeri postavljanja ženskih lica na postojeće videozapise iz pornografskih filmova. Tom su se metodom poslužili neki bivši partneri koji su lica djevojaka koje su prekinule s njima postavili na tijela glumica u pornićima. Takvi videozapisi lako se mogu proširiti internetom, a čak i kada se otkrije da je riječ o deepfakeu, nepovratna šteta za te djevojke već je napravljena.

Tehnologija bi se mogla koristiti i npr. u političkim obračunima te su već objavljivani videozapisi političara čiji su govori gotovo pa savršeni lažirani. Kada se tako nešto pojavi nekoliko sati prije izbora i prije nego što se uspije demantirati njihova vjerodostojnost videozapisa, dio ljudi možda će već promijeniti izbor kandidata za koji su namjeravali glasati.

Koliko deepfake videozapisi mogu biti realni, možemo vidjeti i na videu koji se ovaj tjedan pojavio na YouTubeu i u kojem Elon Musk i Jeff Bezos "glume" u Zvjezdanim stazama. Za one koji ne znaju da je riječ o šefovima Amazona i Tesle, u tom videu vjerojatno nema ništa sporno i teško bi zaključili da je napravljen zahvaljujući tehnologiji i deepfakeu. Na The Vergeu komentirali su kako je video zastrašujuće impresivan te nam pokazuje koliko je danas zaista teško razlikovati stvarne od lažnih događaja, odnosno videa, a jasno je kako će u budućnosti i s napretkom tehnologije to biti još i teže.