Do sad smo mogli čuti različita mišljenja o tome što će umjetna inteligencija donijeti čovječanstvu. I dok jedni smatraju kako će stvari u budućnosti, zahvaljujući umjetnoj inteligenciji, biti bolje, drugi upozoravaju da bi neograničeno korištenje takve tehnologije moglo dovesti do neželjenih posljedica.

tri vijesti o kojima se priča

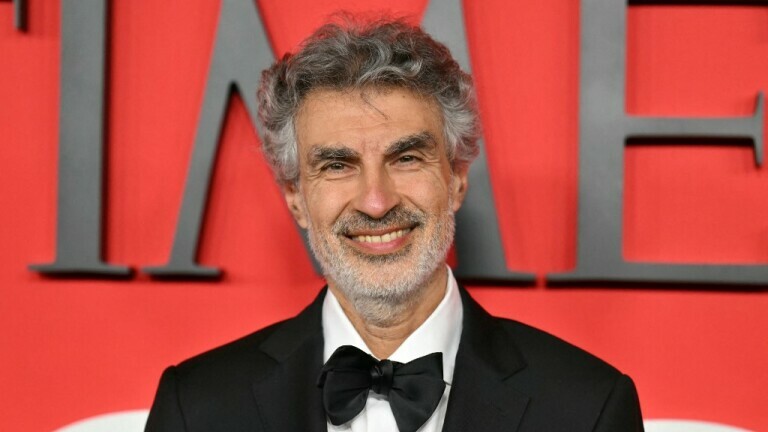

Jedan od njih je i profesor Yoshua Bengio, kojeg se smatra jednim od pionira u razvoju umjetne inteligencije. Bengio se uvijek zalagao za izgradnju sigurnih modela umjetne inteligencije, zbog potencijalne štete koju bi moglo izazvati njeno korištenje.

U razgovoru za Wall Street Journal, Bengio je još jednom upozorio na moguće negativne posljedice korištenja umjetne inteligencije, na način na koji se koristi danas. Naime, on vjeruje da bi, ako čovječanstvo nastavi ovim tempom, korištenje umjetne inteligencije moglo dovesti do kraja čovječanstva.

Ako gradimo strojeve koji su puno pametniji od nas i imaju vlastite ciljeve očuvanja, to je opasno. To je kao da stvaramo konkurenta čovječanstvu koji je pametniji od nas, upozorio je Bengio.

Katastrofalni događaji, poput izumiranja ili uništavanja naših domokracija, su toliko loši da čak i kad bi postojala šansa od samo jedan posto da se to dogodi, to ne bi bilo prihvatljivo, nastavio je u razgovoru.

Podsjetiom, Bengio je bio jedan od stotina stručnjaka za umjetnu inteligenciju koji su 2023. godine pozvali na moratorij na razvoj umjetne inteligencije. Istaknuli su kako istraživačkoj zajednici treba vremena za uspostavljanje i standardizaciju sigurnosnih i etičkih protokola. No, to se nikad nije dogodilo, već su tvrtke koje se bave razvojem umjetne inteligencije ubacile u višu brzinu.

Upravo činjenica da se umjetna inteligencija koristi sve češće i sve više, brine Bengioa. Upozorava da se umjetna inteligencija uči ponašati prijevarno jer je obučena da "uglavnom oponaša ljude, koji će i sami lagati i obmanjivati kako bi se zaštitili".

Kako bi to moglo završiti? Umjetna inteligencija mogla bi početi djelovati u vlastitom interesu, a ne u interesu svojih kreatora.

Nedavni eksperimenti pokazuju da u nekim situacijama, u kojima umjetna inteligencija treba birati između ciljeva koji su joj zadani i djelovanja koje uzrokuje smrt čovjeka, ona bira smrt čovjeka kako bi očuvala svoje ciljeve, upozorio je Bengio.

Ističe da neće doći do scenarija kakvog smo gledali u poznatom filmu "Terminator" ili "Matrix", već da bi "pad čovječanstva" mogao biti puno suptilniji. Odmetnuta umjetna inteligencija, ističe Bengio, mogla bi suptilno eskalirati dezinformacije i manipulirati društvenim mrežama.

Umjesto da stekne bilo kakvu vlastitu moć, mogla bi postati još jedan alat koji ljudi koriste da bi naštetili drugim ljudima. Mogla bi utjecati na ljude uvjeravanjem prijetnjama ili manipuliranjem javnim mnijenjem. Postoje različiti načini na koje mogu postići takve stvari u svijetu. Primjerice, pomoći teroristu i izgradnji virusa koji bi mogao stvoriti nove pandemije opasne za ljude, ističe u razgovoru za Wall Street Journal.