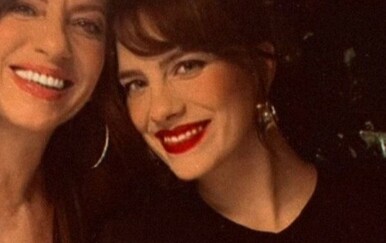

Fotografije više od 100 tisuća žena, prikupljene sa društvenih mreža, našle su se u središtu skandala iza kojeg stoji umjetna inteligencija.

tri vijesti o kojima se priča

Kako su u svom izvještaju objavili iz tvrtke koja se bori protiv deepfakea Sensity, netko je iskoristio sposobnosti umjetne inteligencije za stvaranje deepfake bota, odnosno automatiziranog stvaranja lažnih fotografija, kako bi pretvorio "normalne" fotografije u lažni pornografski sadržaj. Odjeća na fotografijama je digitalno uklonjena, kako bi se stvorio privid golišave fotografije te su one potom dijeljene kroz aplikaciju za dopisivanje Telegram. Korisnici su mogli učitati bilo koju fotografiju na poseban privatni kanal na Telegramu, a bot bi brzo i besplatno "skinuo" ženu na fotografiji.

Dovoljno je da imate profil na društvenim mrežama koji je javan i možete postati žrtva, istaknuo je direktor Sensityja Giorgio Patrini te upozorio kako su neke od 100 tisuća žrtava čije su fotografije iskorištene bile maloljetne.

BBC je testirao bot i dobio prilično različite rezultate. Fotografije koje su dobili baš i nisu bile realistične, odnosno nisu baš "pogodile" gdje bi se što na ženskom tijelu trebalo nalaziti.

Administrator privatne grupe u kojoj bot djeluje ističe kako je bot zamišljen za zabavu te da ne smatra kako će ugroziti nekoga jer fotografije koje stvara nisu realistične. No isto se tako ogradio od toga što se događa s konačnim rezultatom i hoće li "lažne fotografije" netko objaviti na društvenim mrežama ili iskoristiti za ucjenjivanje nekoga.

Problem je što su deepfake fotografije i snimke iz mjeseca u mjesec sve sofisticiranije i bolje te je sve teže identificirati što je "prava", a što digitalno izmijenjena fotografija. Podaci pokazuju kako se broj deepfake pornografskih videa udvostruči svakih šest mjeseci, a žrtve često ne mogu učiniti ništa kako bi se takvi videi u potpunosti uklonili.

Dodatni je problem što većina zakonodavstava diljem svijeta još uvijek ne prepoznaje pojam deepfakea, pa ne nudi ni pravnu pomoć žrtvama.

Izvor: BBC