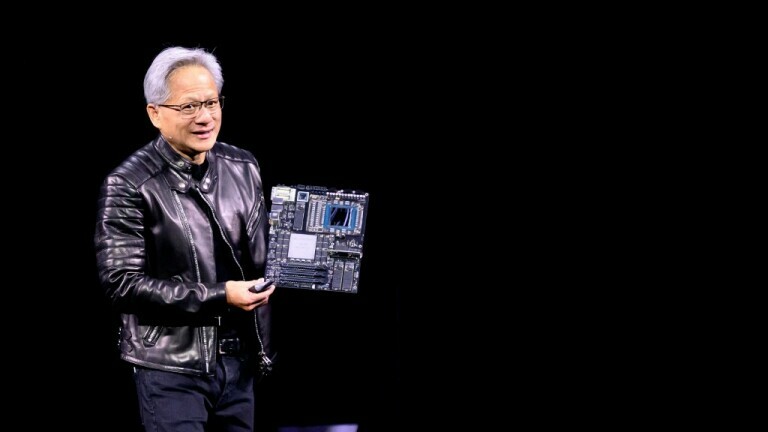

Val interesa za načine na koje se AI modeli primjenjuju potaknuo je Nvidiju da predstavi nove dokaze o tome kako njezina najnovija serverska arhitektura može znatno ubrzati njihov rad u stvarnim uvjetima.

tri vijesti o kojima se priča

Nvidia je u srijedu objavila podatke koji pokazuju deseterostruke dobitke u izvođenju sustava temeljenih na takozvanom “mixture-of-experts” pristupu, tehnici koja dijeli elemente upita na specijalizirane unutarnje module.

Reuters izvještava da je taj pristup postao središtem pozornosti nakon što je kineski AI model DeepSeek, koji ga koristi, početkom 2025. godine objavio model otvorenog koda s neočekivano visokim performansama postignutim na manjem broju Nvidijinih čipova. Od tada tu su metodologiju usvojili i tvrtke OpenAI, Mistral u Francuskoj te kineska tvrtka Moonshot AI.

Nvidia je naglasila da njezin najnoviji poslužitelj, sa 72 vrhunska čipa povezana brzim spojevima, postiže deseterostruko ubrzanje u obradi upita na modelu Kimi K2 Thinking tvrtke Moonshot, što je u skladu s rezultatima ranije postignutima i na DeepSeekovim AI modelima.

Prema Nvidiji, prednost proizlazi iz gustoće čipova i brzine međusobne komunikacije, područja u kojima tvrtka još uvijek nadmašuje konkurente. Ti rezultati naglašavaju Nvidijine napore da zadrži vodeću poziciju, dok globalna uporaba umjetne inteligencije nastavlja ubrzano rasti.

Iako Nvidia i dalje dominira fazom uvježbavanja AI modela, područje njihove primjene brzo se pretvara u polje oštre konkurencije, u kojem AMD i Cerebras nude svoje sustave za obradu velikog broja korisnika.

AMD u tom smislu priprema vlastiti poslužitelj s više snažnih čipova, čiji je izlazak na tržište najavljen za iduću godinu.