Sa svakom snažnom i disruptivnom tehnologijom koja se u povijesti pojavila postojali su i određeni rizici, a isti je slučaj i s umjetnom inteligencijom te se moramo zapitati što trebamo napraviti kako bi osigurali da AI isključivo pomaže ljudima i da nam nikada ne naudi, naglasila je na predavanju tijekom Windaysa Daria Brashkina iz njemačkog odjela Microsofta.

tri vijesti o kojima se priča

Na samom početku predavanja AI je definirala kao skup tehnologija koje računalima omogućuju postupanje, učenje i asistiranje u donošenju odluka s kojima se rješavaju problemi na sličan način na koji to rade i ljudi. No ako računala i umjetna inteligencija donose odluke kao i ljudi, tko će onda biti odgovoran za njihove postupke, odnosno što ako AI donose neke loše odluke s negativnim posljedicama - tko će odgovarati za te posljedice.

Trenutačno takvi zakoni ne postoje - u nekim se slučajevima koriste zakoni povezani s privatnosti i upravljanjem podataka, no Brashkina naglašava kako je danas potrebna globalna konverzacija u kojoj trebaju sudjelovati vlade koje će donositi zakone i developeri koji razvijaju tehnologije. Kakvi će to biti zakoni, to još nitko ne zna i upravo zbog toga su potrebni razgovori kako bi se pronašlo zajedničko i učinkovito rješenje.

Etika i umjetna inteligencija

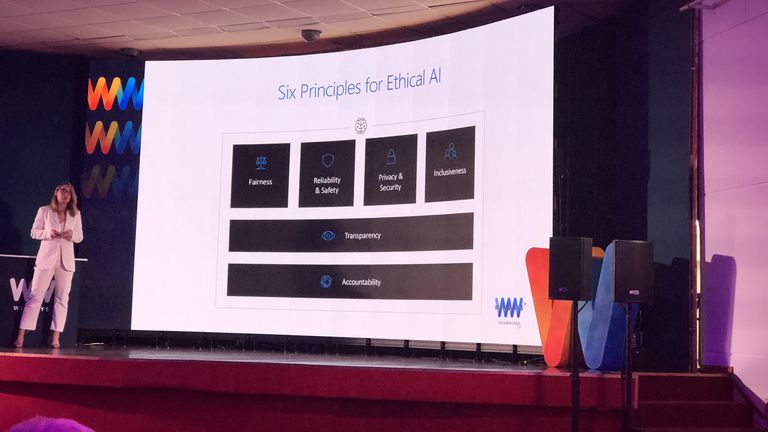

Kada već ne postoje zakoni, niti su nam poznata neka opća pravila vezana uz razvoj umjetne inteligencije, Microsoft je odlučio razviti neke svoje smjernice, odnosno šest principa za etičku AI koje implementira u svoje proizvode koji koriste umjetnu inteligenciju – to je neka vrsta Hipokratove zakletve za sve osobe koje sudjeluju u razvoju AI.

Prvi princip je fairness, odnosno u razvoju AI trebali bi sudjelovati različiti ljudi, koji dolaze iz različitih kulturnih sredina i s različitim pogledima na život, kako bi se izbjegle predrasude. Sljedeći princip je pouzdanost koja uključuje praćenje performansi te mora biti dizajnirana za neočekivane okolnosti i napade. Od iznimne važnosti je, naravno, sigurnost, dok je četvrti princip uključenost pri čemu je od velike važnosti uključiti što više ljudi u proces razvoja te ukloniti sve barijere koje potencijalno mogu nenamjerno isključiti neke ljude iz sudjelovanja u razvoju AI.

Zadnja takva dva "stupa" na kojima je Microsoft bazirao razvoj umjetne inteligencije odnose se na transparentnost – ljudima mora biti jasan način na koji se donose odluke te treba pojednostaviti podizanje svjesnosti ljudi oko potencijalnih grešaka i predrasuda umjetne inteligencije te, naravno, na odgovornost. Pitanje odgovornosti je najteže pitanje, no Brashkina kaže da su uvijek odgovorni - ljudi. Naime, ne možemo samo nešto napraviti, razviti neku tehnologiju i onda reći da nismo više odgovorni za ono što smo napravili.

Za neke posebne situacije i osjetljive scenarije, Microsoft ima poseban odbor koji prate takve projekte AETHER, a pokrenuli su i PAI - Partnership on AI, odnosno partnerstvo za razgovore i rasprave oko umjetne inteligencije (s ciljem razvoja i dijeljenja najboljih praksi oko AI kao i razvoja društveno korisne AI) u kojem sudjeluje više od 50 organizacija diljem svijeta.

Sljedeći korak trebala bi biti nova generacija zakona koja će biti prilagođena modernim vremenima i digitalnim tehnologijama, no Daria Brashkina upozorila je na opasnost pretjerane regulative koja bi mogla usporiti razvoj AI-a i time utjecati na tehnološki razvoj i napredak gospodarstva.