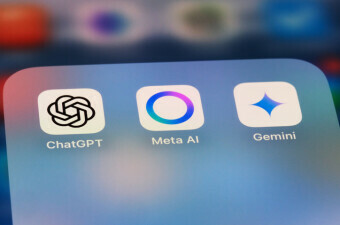

Prednosti umjetne inteligencije i chatbotova poput ChatGPT-a odavno su prepoznali i kibernetički kriminalci. Oni AI koriste za različite svrhe, uključujući i za pisanje malicioznog koda koji iskorištavaju za napade na korisnike, organizacije, države itd.

tri vijesti o kojima se priča

No pored klasičnih hakera koji su prvenstveno financijski motivirani, ovim se alatima služe i sjevernokorejski i kineski hakeri kojima je u prvom planu špijunaža. A posebno je zanimljivo kako je njima poslužio ChatGPT u napadima te pokazuje dozu lukavosti, ali i lakoće s kojom je danas zahvaljujući ovoj tehnologiji moguće jednostavno izvršiti prevaru.

Lažirali vojne iskaznice

Sjevernokorejska hakerska grupa poznata kao Kimusky tako je nedavno iskoristila ChatGPT za generiranje lažnih iskaznica južnokorejske vojske. Te su iskaznice priložili su phishing mailove u kojima su se predstavili kao južnokorejska institucija povezana s ministarstvom obrane koja je odgovorna za izdavanje vjerodajnica vojnim dužnosnicima. Iako je ChatGPT treniran tako da ne može, tj. ne smije napraviti službene vladine identifikacijske dokumente, postoje načini na koji se može prevariti umjetna inteligencija.

Npr. model se može nagovoriti na generiranje uvjerljivih kopija, ako se upit postavi tako da je potreban primjer dizajna iskaznica u legitimne svrhe, a ne kao reprodukcija stvarnih dokumenata i vojnih iskaznica. Čini se kako su se sjevernokorejski hakeri poslužili upravo tom metodom.

Hakerska grupa Kimusky godinama napada i špijunira osobe i organizacije iz Južne Koreje, Japana i SAD-a, a Amerikanci su ih još prije 5 godina optužili za povezanost sa sjevernokorejskim režimom u čije ime prikupljaju obavještajne podatke.

Koriste i Claude i Gemini

Osim ChatGPT-a, hakeri iz Sjeverne Koreje koriste i druge AI alate pa su tako prošlog mjeseca iz Anthropica upozorili na sjevernokorejske hakere kojima je u prevarama pri zaposlenju pomogao i njihov AI alat Claude. Naime, oni bi se javljali na poslove u američkim kompanijama koje mogu raditi u potpunosti udaljeno. Pri tome su za pisanje uvjerljivih životopisa i portfelja, kao i za polaganje testova kodiranja koristili upravo Claude. Također, ovaj su AI alat koristili čak i za izvršavanje stvarnih tehničkih zadataka.

Mogućnosti Claudea iskoristili su i kineski hakeri, upozorili su u istom izvještaju iz Anthropica. Njima je taj AI alat poslužio kao asistent u brojnim fazama kibernetičkih napada na više vijetnamskih telekoma, vladinih baza podataka te poljoprivrednih sustava. Claude je ne samo pomogao u programiranju koda, već je bio i tehnički savjetnik, sigurnosni analitičar i operativni konzultant u pripremi i izvršenju napada.

Nakon tih otkrića iz Anthropica su implementirali nove načine za otkrivanje zlouporabe svojih alata pa se nadaju kako se slične stvari više neće ponoviti.

To su samo neki od primjera u kojima su hakeri iskoristili umjetnu inteligenciju, a osim ChatGPT-a i Claudea, iskoristili su i Googleov Gemini koji im se također pokazao korisnim u kibernetičkim napadima.

Izvor: Business Insider