Može li stroj kojim upravlja umjetna inteligencija uspješno uvjeriti gledatelje u debati s čovjekom? Znanstvenici iz IBM Researcha u Haifi u Izraelu vjeruju da je to moguće.

tri vijesti o kojima se priča

U tom smislu opisali su rezultate eksperimenta u kojem je umjetna inteligencija sudjelovala u debati uživo s čovjekom, dok je zadatak publike bio ocijeniti kvalitetu govora koje su čuli. Umjetna inteligencija je za svoju izvedbu u debati dobila visoke ocjene, odnosno njezin nastup ocijenjen je kao vrlo sličan ljudskom.

Takvo postignuće je vrlo jasan pokazatelj koliko je daleko umjetna inteligencija u oponašanju korištenja jezika na ljudskoj razini.

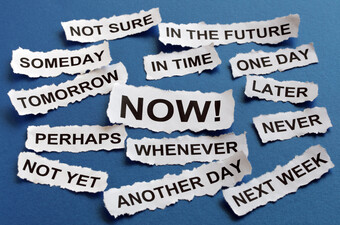

No s daljnjim razvojem te tehnologije, navedeno istraživanje je isto tako i podsjetnik da su prijeko potrebne i vrlo jasne smjernice, ako već ne i vrlo jasna pravila, oko u najmanju ruku transparentnosti umjetne inteligencije, kako bi ljudi znali razgovaraju li sa strojem ili s drugom osobom.

Naime, umjetna inteligencija mogla bi jednog dana razviti i manipulativne vještine, što bi samo dodatno povećalo potrebu za ozbiljnim nadzorom.

Sustav umjetne inteligencije koji koriste u IBM-u zove se Project Debater. RIječ je o formatu debate u kojoj sugovornici imaju četiri minute za uvodnu riječ, nakon čega slijede replike te na kraju i završne riječi. Teme tih debata su doista raznolike, a Project Debater odmjerio je snage s drugim sustavima umjetne inteligencije poput GTP-2 (Generative Pretrained Transformer) tvrtke OpenAI, kojeg je nadmašio po mišljenju ljudske publike, ali i s nagrađivanim govornikom na temu treba li država davati poticaje vrtićima.

Project Debater je algoritam strojnog učenja, što u principu znači da vještinu stječe iz postojećih podataka. Drugim riječim, taj algoritam izolira informacije o specifičnoj temi iz baze podataka od 400 milijuna novinskih članaka te ih kombinira u tekst koji je semantički vezan za zadanu temu, a nakon toga kompilira sav taj relevantan materijal u argumente koje će koristiti u debati.

Sustavi umjetne inteligencije poput toga rade u verziji strojnog učenja koje se naziva i duboko učenje.

Obzirom da se podaci na temelju kojih umjetna inteligencija uči izvlače iz ljudski unesenih izvora, javlja se i problem da bi umjetna inteligencija sukladno tome mogla pokupiti i ljudske predrasude poput rasizma i seksizma. Dok su znanstvenici toga svjesni te neki od njih rade na uzimanju toga u obzir, isto se ne može očekivati zdravo za gotovo u budućnosti i od strane korporacija.

Specijalist za umjetnu inteligenciju sa sveučilišta California, Stuart Russell, rekao je za Nature da bi ljudi uvijek trebali imati pravo znati imaju li interakciju sa strojem, što bi svakako uključivalo i pravo znanja pokušava li ih stroj uvjeriti ili nagovoriti u/na nešto. Jednako je važno, kaže, osigurati i da osoba ili organizacija iza te umjetne inteligencije budu transparentno vidljivi i da im se lako može ući u trag u slučaju da dođe do neželjenih posljedica po ljude.

Noam Slonim, glavni istražitelj na Project Debateru, tvrdi da IBM uključuje politiku transparentnosti za svoja istraživanja o umjetnoj inteligenciji. Primjerice, podaci na kojima uči i algoritmni su otvoreno dostupni. Povrh toga, u javnim debatama, kreatori Project Debatera namjerno nisu htjeli da glas njihove umjetne inteligencije bude presličan ljudskom, kako to ne bi zavaralo publiku na pomisao da je riječ o pravoj osobi.

No postoje stvari koje umjetna inteligencija ne može svladati dubokim učenje, a spadaju u ono što psiholozi nazivaju teorijom uma. Naime, ljudski diskurs se vodi implicitnim pretpostavkama koje govornik donosi o svojoj publici i načinu na kojiista prosuđuje i razumije sadržaj.

Takvo što ne može se dobiti dubokim kopanjem po podacima, no znanstvenici su počeli ugrađivati neke elemente teorije uma u svoje modele umjetne inteligencije, s implikacijom da bi algoritmi mogli postajati sve više skloni manipulativnom ponašanju.

Takvo što bi svakako bilo interesantno kompanijama koje žele prodati što više svojih proizvoda potrošačima. No, to je samo još jedan razlog više za uvođenje ragulative kako bi se osigurala transparentnost i smanjila potencijalna šteta.

Izvor: Nature