Znanstvenici već godinama upozoravaju na opasnost od autonomnog naoružanja pa su čak i potpisali peticiju usmjerenu na zaustavljanje razvoja tzv. robota ubojica. Takvo naoružanje, tehnološki napredno i uz upravljanje umjetne inteligencije, trebalo bi imati mogućnost da samo odlučuje o metama napada u sukobima. Jasno, postoje brojni negativni scenariji za takve situacije, a jedan je očit - kada AI naoružanje krene udarati po civilima ili vlastitoj vojsci.

tri vijesti o kojima se priča

Zato se u SAD-u puno raspravlja o razvoju i primjeni takvog autonomnog naoružanja. Zanimljivo je kako američka vojska tu ideju nije zabranila, ali nije donesena niti neka regulativa s kojom se njena uporaba dopušta.

O uporabi ovog naoružanja raspravljaju i šefovi startupova orijentiranih na razvoj obrambene tehnologije, a njihova se razmišljanja razlikuju. Prošlog mjeseca tako je suosnivač Shield AI-a Brandon Tseng komentirao kako AI algoritmi ne bi trebali donositi samostalne odluke o metama napada, odnosno ubijanja: Kongres to ne želi. Nitko to ne želi, rekao je tada.

No čini se da to baš i nije istina. Naime, samo par dana nakon toga suosnivač obrambenog startupa Anduril Palmer Luckey, koji je javnosti postao poznat nakon što je prodao svoj AI startup Oculus Facebooku, odnosno sadašnjoj Meti, iznio je drukčije razmišljanje. On se upitao mogu li se ljudi već sada složiti oko toga da roboti nikada neće moći odlučiti tko će živjeti i umrijeti i upitao se što u situacijama u kojima će jasno moći razlikovati školski autobus od ruskog tenka.

Tijekom jednog razgovora s novinarima, drugi suosnivač ove tvrtke Trae Stephens rekao je kako bi tehnologija koju razvijaju trebala omogućiti ljudima da donose ispravne odluke te da bi u svakoj odluci koja uključuje ubojstva trebala biti neka “odgovorna strana”, no kako je naknadno komentirao glasnogovornik Andurila, to ne znači da bi ljudi uvijek trebali donositi odluke, već samo da bi netko trebao biti odgovoran za te odluke.

Slično, odnosno dvosmisleno stajalište ima i američka vlada, komentirali su na Tech Crunchu. Naime, iako koliko je poznato, američka vojska ne kupuje, niti razvija takvo autonomno oružje, američka vlada ne zabranjuje kompanijama proizvodnju ubojitog autonomnog naoružanja, niti zabranjuje njegovu prodaju drugim državama.

Iako je američka vojska objavila smjernice prema kojima osobe najvišeg vojnog čina moraju odobriti uporabu novog autonomnog naoružanja, te su smjernice dobrovoljne, a američka vlada i vojska konstantno govore kako još nije pravo vrijeme za raspravu o zabrani autonomnog naoružanja.

Fleksibilniji pristup

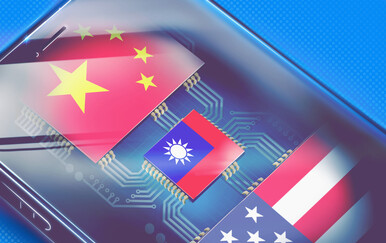

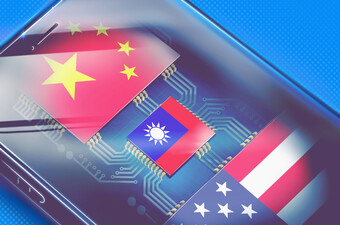

Joe Lonsdale, jedan od suosnivača Palantira i investitor u Anduril dao je drukčiju perspektivu pogleda na autonomiju u naoružanju. Prema njemu, stvari nisu tako crno-bijele, odnosno pitanje ne bi trebalo biti postavljeno u smislu treba li ili ne treba omogućiti autonomno AI naoružanje te se upitao što ako Kina prva odobri takvo oružje.

Zato je potaknuo “fleksibilniji pristup” umjetnoj inteligenciji u naoružanju, naglasivši kako konačnu odluku o autonomiji ne bi trebali donijeti startupovi i kompanije koje razvijaju naoružanje, već donosioci političkih odluka. No pri tome je važno da to ne budu obični birokrati, već osobe koje su dobro upoznate sa situacijom te da mogu donijeti pravodobne odluke bazirane na njihovoj educiranosti.

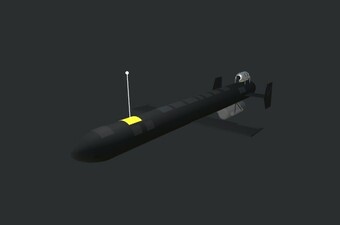

Koliko je važna umjetna inteligencija u naoružanju možemo vidjeti i na primjeru rusko-ukrajinskog sukoba u kojem se ukrajinska vojska zalaže za što više korištenja umjetne inteligencije i automatizacije kako bi stekle prednost pred Rusijom.

S druge strane, najveći strah u Silicijskoj dolini i službenicima u Washingtonu jest da Kinezi i Rusi prvi razviju autonomno naoružanje. Time bi stekli veliku vojnu prednost koja bi mogla biti i presudna u nekakvim borbama, a da Rusi gledaju u tom smjeru može se zaključiti na temelju prošlogodišnjeg komentara jednog ruskog diplomata pri UN-u: Shvaćamo da je za mnoge delegacije prioritet ljudska kontrola: Za Rusiju, prioriteti su nešto drukčiji.

Izvor: Tech Crunch